概述

构建代理(或任何 LLM 应用程序)的难点在于使其足够可靠。虽然它们可能在原型阶段有效,但在实际用例中常常失败。代理为何失败?

当代理失败时,通常是因为代理内部的 LLM 调用采取了错误的操作 / 未执行我们预期的操作。LLM 失败的原因有两个:- 底层 LLM 能力不足

- 未将“正确”的上下文传递给 LLM

刚接触上下文工程?请从概念概述开始,了解不同类型的上下文及其使用时机。

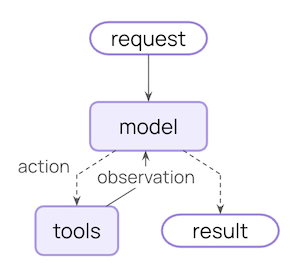

代理循环

典型的代理循环包含两个主要步骤:- 模型调用 - 使用提示和可用工具调用 LLM,返回响应或执行工具的请求

- 工具执行 - 执行 LLM 请求的工具,返回工具结果

可控内容

要构建可靠的代理,您需要控制代理循环每个步骤中发生的事情,以及步骤之间发生的事情。临时上下文

LLM 在单次调用中看到的内容。您可以修改消息、工具或提示,而无需更改保存在状态中的内容。

持久上下文

在多轮对话中保存在状态中的内容。生命周期钩子和工具写入会永久修改此内容。

数据源

在此过程中,您的代理会访问(读取/写入)不同的数据源:| 数据源 | 也称为 | 范围 | 示例 |

|---|---|---|---|

| 运行时上下文 | 静态配置 | 会话范围 | 用户 ID、API 密钥、数据库连接、权限、环境设置 |

| 状态 | 短期记忆 | 会话范围 | 当前消息、上传的文件、身份验证状态、工具结果 |

| 存储 | 长期记忆 | 跨会话 | 用户偏好、提取的见解、记忆、历史数据 |

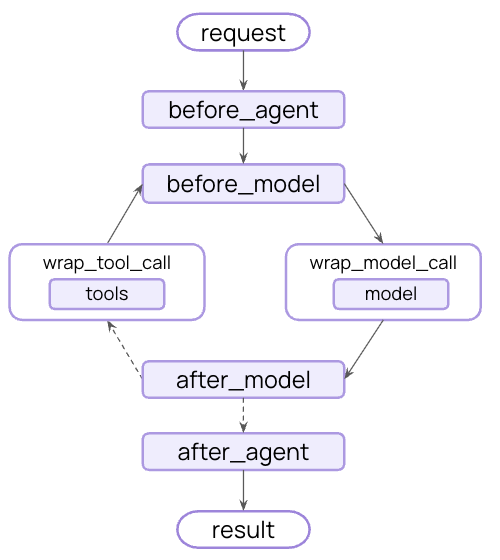

工作原理

LangChain 中间件 是底层机制,使上下文工程对于使用 LangChain 的开发人员来说变得实用。 中间件允许您挂钩到代理生命周期的任何步骤,并:- 更新上下文

- 跳转到代理生命周期中的不同步骤

模型上下文

控制每个模型调用的输入内容——指令、可用工具、要使用的模型以及输出格式。这些决策直接影响可靠性和成本。系统提示

开发者向 LLM 提供的基本指令。

消息

发送给 LLM 的完整消息列表(对话历史)。

工具

代理可用于采取操作的实用程序。

模型

要调用的实际模型(包括配置)。

响应格式

模型最终响应的模式规范。

系统提示

系统提示设置 LLM 的行为和能力。不同的用户、上下文或对话阶段需要不同的指令。成功的代理会利用记忆、偏好和配置,为对话的当前状态提供正确的指令。- 状态

- 存储

- 运行时上下文

从状态访问消息计数或对话上下文:

from langchain.agents import create_agent

from langchain.agents.middleware import dynamic_prompt, ModelRequest

@dynamic_prompt

def state_aware_prompt(request: ModelRequest) -> str:

# request.messages 是 request.state["messages"] 的快捷方式

message_count = len(request.messages)

base = "You are a helpful assistant."

if message_count > 10:

base += "\nThis is a long conversation - be extra concise."

return base

agent = create_agent(

model="gpt-4.1",

tools=[...],

middleware=[state_aware_prompt]

)

从长期记忆访问用户偏好:

from dataclasses import dataclass

from langchain.agents import create_agent

from langchain.agents.middleware import dynamic_prompt, ModelRequest

from langgraph.store.memory import InMemoryStore

@dataclass

class Context:

user_id: str

@dynamic_prompt

def store_aware_prompt(request: ModelRequest) -> str:

user_id = request.runtime.context.user_id

# 从存储读取:获取用户偏好

store = request.runtime.store

user_prefs = store.get(("preferences",), user_id)

base = "You are a helpful assistant."

if user_prefs:

style = user_prefs.value.get("communication_style", "balanced")

base += f"\nUser prefers {style} responses."

return base

agent = create_agent(

model="gpt-4.1",

tools=[...],

middleware=[store_aware_prompt],

context_schema=Context,

store=InMemoryStore()

)

从运行时上下文访问用户 ID 或配置:

from dataclasses import dataclass

from langchain.agents import create_agent

from langchain.agents.middleware import dynamic_prompt, ModelRequest

@dataclass

class Context:

user_role: str

deployment_env: str

@dynamic_prompt

def context_aware_prompt(request: ModelRequest) -> str:

# 从运行时上下文读取:用户角色和环境

user_role = request.runtime.context.user_role

env = request.runtime.context.deployment_env

base = "You are a helpful assistant."

if user_role == "admin":

base += "\nYou have admin access. You can perform all operations."

elif user_role == "viewer":

base += "\nYou have read-only access. Guide users to read operations only."

if env == "production":

base += "\nBe extra careful with any data modifications."

return base

agent = create_agent(

model="gpt-4.1",

tools=[...],

middleware=[context_aware_prompt],

context_schema=Context

)

消息

消息构成发送给 LLM 的提示。 管理消息内容至关重要,以确保 LLM 拥有正确的信息来做出良好响应。- 状态

- 存储

- 运行时上下文

在相关时,从状态注入上传的文件上下文到当前查询:

from langchain.agents import create_agent

from langchain.agents.middleware import wrap_model_call, ModelRequest, ModelResponse

from typing import Callable

@wrap_model_call

def inject_file_context(

request: ModelRequest,

handler: Callable[[ModelRequest], ModelResponse]

) -> ModelResponse:

"""注入用户在此会话中上传的文件上下文。"""

# 从状态读取:获取上传的文件元数据

uploaded_files = request.state.get("uploaded_files", [])

if uploaded_files:

# 构建关于可用文件的上下文

file_descriptions = []

for file in uploaded_files:

file_descriptions.append(

f"- {file['name']} ({file['type']}): {file['summary']}"

)

file_context = f"""Files you have access to in this conversation:

{chr(10).join(file_descriptions)}

Reference these files when answering questions."""

# 在最近的消息之前注入文件上下文

messages = [

*request.messages,

{"role": "user", "content": file_context},

]

request = request.override(messages=messages)

return handler(request)

agent = create_agent(

model="gpt-4.1",

tools=[...],

middleware=[inject_file_context]

)

从存储注入用户的电子邮件写作风格以指导草拟:

from dataclasses import dataclass

from langchain.agents import create_agent

from langchain.agents.middleware import wrap_model_call, ModelRequest, ModelResponse

from typing import Callable

from langgraph.store.memory import InMemoryStore

@dataclass

class Context:

user_id: str

@wrap_model_call

def inject_writing_style(

request: ModelRequest,

handler: Callable[[ModelRequest], ModelResponse]

) -> ModelResponse:

"""从存储注入用户的电子邮件写作风格。"""

user_id = request.runtime.context.user_id

# 从存储读取:获取用户的写作风格示例

store = request.runtime.store

writing_style = store.get(("writing_style",), user_id)

if writing_style:

style = writing_style.value

# 从存储的示例构建风格指南

style_context = f"""Your writing style:

- Tone: {style.get('tone', 'professional')}

- Typical greeting: "{style.get('greeting', 'Hi')}"

- Typical sign-off: "{style.get('sign_off', 'Best')}"

- Example email you've written:

{style.get('example_email', '')}"""

# 附加在末尾 - 模型更关注最终消息

messages = [

*request.messages,

{"role": "user", "content": style_context}

]

request = request.override(messages=messages)

return handler(request)

agent = create_agent(

model="gpt-4.1",

tools=[...],

middleware=[inject_writing_style],

context_schema=Context,

store=InMemoryStore()

)

根据用户的司法管辖区从运行时上下文注入合规规则:

from dataclasses import dataclass

from langchain.agents import create_agent

from langchain.agents.middleware import wrap_model_call, ModelRequest, ModelResponse

from typing import Callable

@dataclass

class Context:

user_jurisdiction: str

industry: str

compliance_frameworks: list[str]

@wrap_model_call

def inject_compliance_rules(

request: ModelRequest,

handler: Callable[[ModelRequest], ModelResponse]

) -> ModelResponse:

"""从运行时上下文注入合规约束。"""

# 从运行时上下文读取:获取合规要求

jurisdiction = request.runtime.context.user_jurisdiction

industry = request.runtime.context.industry

frameworks = request.runtime.context.compliance_frameworks

# 构建合规约束

rules = []

if "GDPR" in frameworks:

rules.append("- Must obtain explicit consent before processing personal data")

rules.append("- Users have right to data deletion")

if "HIPAA" in frameworks:

rules.append("- Cannot share patient health information without authorization")

rules.append("- Must use secure, encrypted communication")

if industry == "finance":

rules.append("- Cannot provide financial advice without proper disclaimers")

if rules:

compliance_context = f"""Compliance requirements for {jurisdiction}:

{chr(10).join(rules)}"""

# 附加在末尾 - 模型更关注最终消息

messages = [

*request.messages,

{"role": "user", "content": compliance_context}

]

request = request.override(messages=messages)

return handler(request)

agent = create_agent(

model="gpt-4.1",

tools=[...],

middleware=[inject_compliance_rules],

context_schema=Context

)

临时与持久消息更新:上述示例使用

wrap_model_call 进行临时更新——修改发送给模型的消息,仅针对单次调用,而不更改保存在状态中的内容。对于持久更新(修改状态),您可以:- 从

wrap_model_call返回一个包含Command的ExtendedModelResponse,以从模型调用层注入状态更新。 - 使用生命周期钩子,如

before_model、after_model或wrap_tool_call(用于工具返回)来更新对话历史。有关更多详细信息,请参阅中间件文档。

工具

工具使模型能够与数据库、API 和外部系统交互。您定义和选择工具的方式直接影响模型能否有效完成任务。定义工具

每个工具都需要一个清晰的名称、描述、参数名称和参数描述。这些不仅仅是元数据——它们指导模型关于何时以及如何使用工具的推理。from langchain.tools import tool

@tool(parse_docstring=True)

def search_orders(

user_id: str,

status: str,

limit: int = 10

) -> str:

"""Search for user orders by status.

Use this when the user asks about order history or wants to check

order status. Always filter by the provided status.

Args:

user_id: Unique identifier for the user

status: Order status: 'pending', 'shipped', or 'delivered'

limit: Maximum number of results to return

"""

# Implementation here

pass

选择工具

并非每个工具都适用于所有情况。工具过多可能会使模型不堪重负(上下文过载)并增加错误;工具过少则会限制功能。动态工具选择可根据身份验证状态、用户权限、功能标志或对话阶段调整可用工具集。- 状态

- 存储

- 运行时上下文

仅在特定对话里程碑后启用高级工具:

from langchain.agents import create_agent

from langchain.agents.middleware import wrap_model_call, ModelRequest, ModelResponse

from typing import Callable

@wrap_model_call

def state_based_tools(

request: ModelRequest,

handler: Callable[[ModelRequest], ModelResponse]

) -> ModelResponse:

"""根据对话状态过滤工具。"""

# 从状态读取:检查用户是否已认证

state = request.state

is_authenticated = state.get("authenticated", False)

message_count = len(state["messages"])

# 仅在认证后启用敏感工具

if not is_authenticated:

tools = [t for t in request.tools if t.name.startswith("public_")]

request = request.override(tools=tools)

elif message_count < 5:

# 在对话早期限制工具

tools = [t for t in request.tools if t.name != "advanced_search"]

request = request.override(tools=tools)

return handler(request)

agent = create_agent(

model="gpt-4.1",

tools=[public_search, private_search, advanced_search],

middleware=[state_based_tools]

)

根据存储中的用户偏好或功能标志过滤工具:

from dataclasses import dataclass

from langchain.agents import create_agent

from langchain.agents.middleware import wrap_model_call, ModelRequest, ModelResponse

from typing import Callable

from langgraph.store.memory import InMemoryStore

@dataclass

class Context:

user_id: str

@wrap_model_call

def store_based_tools(

request: ModelRequest,

handler: Callable[[ModelRequest], ModelResponse]

) -> ModelResponse:

"""根据存储偏好过滤工具。"""

user_id = request.runtime.context.user_id

# 从存储读取:获取用户启用的功能

store = request.runtime.store

feature_flags = store.get(("features",), user_id)

if feature_flags:

enabled_features = feature_flags.value.get("enabled_tools", [])

# 仅包含为此用户启用的工具

tools = [t for t in request.tools if t.name in enabled_features]

request = request.override(tools=tools)

return handler(request)

agent = create_agent(

model="gpt-4.1",

tools=[search_tool, analysis_tool, export_tool],

middleware=[store_based_tools],

context_schema=Context,

store=InMemoryStore()

)

根据运行时上下文中的用户权限过滤工具:

from dataclasses import dataclass

from langchain.agents import create_agent

from langchain.agents.middleware import wrap_model_call, ModelRequest, ModelResponse

from typing import Callable

@dataclass

class Context:

user_role: str

@wrap_model_call

def context_based_tools(

request: ModelRequest,

handler: Callable[[ModelRequest], ModelResponse]

) -> ModelResponse:

"""根据运行时上下文权限过滤工具。"""

# 从运行时上下文读取:获取用户角色

user_role = request.runtime.context.user_role

if user_role == "admin":

# 管理员获得所有工具

pass

elif user_role == "editor":

# 编辑器不能删除

tools = [t for t in request.tools if t.name != "delete_data"]

request = request.override(tools=tools)

else:

# 查看者获得只读工具

tools = [t for t in request.tools if t.name.startswith("read_")]

request = request.override(tools=tools)

return handler(request)

agent = create_agent(

model="gpt-4.1",

tools=[read_data, write_data, delete_data],

middleware=[context_based_tools],

context_schema=Context

)

模型

不同的模型具有不同的优势、成本和上下文窗口。为手头的任务选择合适的模型,这可能在代理运行期间发生变化。- 状态

- 存储

- 运行时上下文

根据状态中的对话长度使用不同的模型:

from langchain.agents import create_agent

from langchain.agents.middleware import wrap_model_call, ModelRequest, ModelResponse

from langchain.chat_models import init_chat_model

from typing import Callable

# 在中间件外部初始化模型

large_model = init_chat_model("claude-sonnet-4-6")

standard_model = init_chat_model("gpt-4.1")

efficient_model = init_chat_model("gpt-4.1-mini")

@wrap_model_call

def state_based_model(

request: ModelRequest,

handler: Callable[[ModelRequest], ModelResponse]

) -> ModelResponse:

"""根据状态对话长度选择模型。"""

# request.messages 是 request.state["messages"] 的快捷方式

message_count = len(request.messages)

if message_count > 20:

# 长对话 - 使用具有更大上下文窗口的模型

model = large_model

elif message_count > 10:

# 中等对话

model = standard_model

else:

# 短对话 - 使用高效模型

model = efficient_model

request = request.override(model=model)

return handler(request)

agent = create_agent(

model="gpt-4.1-mini",

tools=[...],

middleware=[state_based_model]

)

使用存储中的用户首选模型:

from dataclasses import dataclass

from langchain.agents import create_agent

from langchain.agents.middleware import wrap_model_call, ModelRequest, ModelResponse

from langchain.chat_models import init_chat_model

from typing import Callable

from langgraph.store.memory import InMemoryStore

@dataclass

class Context:

user_id: str

# 初始化可用模型

MODEL_MAP = {

"gpt-4.1": init_chat_model("gpt-4.1"),

"gpt-4.1-mini": init_chat_model("gpt-4.1-mini"),

"claude-sonnet": init_chat_model("claude-sonnet-4-6"),

}

@wrap_model_call

def store_based_model(

request: ModelRequest,

handler: Callable[[ModelRequest], ModelResponse]

) -> ModelResponse:

"""根据存储偏好选择模型。"""

user_id = request.runtime.context.user_id

# 从存储读取:获取用户的首选模型

store = request.runtime.store

user_prefs = store.get(("preferences",), user_id)

if user_prefs:

preferred_model = user_prefs.value.get("preferred_model")

if preferred_model and preferred_model in MODEL_MAP:

request = request.override(model=MODEL_MAP[preferred_model])

return handler(request)

agent = create_agent(

model="gpt-4.1",

tools=[...],

middleware=[store_based_model],

context_schema=Context,

store=InMemoryStore()

)

根据成本限制或环境从运行时上下文选择模型:

from dataclasses import dataclass

from langchain.agents import create_agent

from langchain.agents.middleware import wrap_model_call, ModelRequest, ModelResponse

from langchain.chat_models import init_chat_model

from typing import Callable

@dataclass

class Context:

cost_tier: str

environment: str

# 在中间件外部初始化模型

premium_model = init_chat_model("claude-sonnet-4-6")

standard_model = init_chat_model("gpt-4.1")

budget_model = init_chat_model("gpt-4.1-mini")

@wrap_model_call

def context_based_model(

request: ModelRequest,

handler: Callable[[ModelRequest], ModelResponse]

) -> ModelResponse:

"""根据运行时上下文选择模型。"""

# 从运行时上下文读取:成本层级和环境

cost_tier = request.runtime.context.cost_tier

environment = request.runtime.context.environment

if environment == "production" and cost_tier == "premium":

# 生产高级用户获得最佳模型

model = premium_model

elif cost_tier == "budget":

# 预算层级获得高效模型

model = budget_model

else:

# 标准层级

model = standard_model

request = request.override(model=model)

return handler(request)

agent = create_agent(

model="gpt-4.1",

tools=[...],

middleware=[context_based_model],

context_schema=Context

)

响应格式

结构化输出将非结构化文本转换为经过验证的结构化数据。当提取特定字段或为下游系统返回数据时,自由格式文本是不够的。 工作原理: 当您提供模式作为响应格式时,模型的最终响应保证符合该模式。代理运行模型/工具调用循环,直到模型完成工具调用,然后将最终响应强制转换为提供的格式。定义格式

模式定义指导模型。字段名称、类型和描述指定了输出应遵循的确切格式。from pydantic import BaseModel, Field

class CustomerSupportTicket(BaseModel):

"""从客户消息中提取的结构化票据信息。"""

category: str = Field(

description="Issue category: 'billing', 'technical', 'account', or 'product'"

)

priority: str = Field(

description="Urgency level: 'low', 'medium', 'high', or 'critical'"

)

summary: str = Field(

description="One-sentence summary of the customer's issue"

)

customer_sentiment: str = Field(

description="Customer's emotional tone: 'frustrated', 'neutral', or 'satisfied'"

)

选择格式

动态响应格式选择根据用户偏好、对话阶段或角色调整模式——早期返回简单格式,随着复杂性增加返回详细格式。- 状态

- 存储

- 运行时上下文

根据对话状态配置结构化输出:

from langchain.agents import create_agent

from langchain.agents.middleware import wrap_model_call, ModelRequest, ModelResponse

from pydantic import BaseModel, Field

from typing import Callable

class SimpleResponse(BaseModel):

"""早期对话的简单响应。"""

answer: str = Field(description="A brief answer")

class DetailedResponse(BaseModel):

"""已建立对话的详细响应。"""

answer: str = Field(description="A detailed answer")

reasoning: str = Field(description="Explanation of reasoning")

confidence: float = Field(description="Confidence score 0-1")

@wrap_model_call

def state_based_output(

request: ModelRequest,

handler: Callable[[ModelRequest], ModelResponse]

) -> ModelResponse:

"""根据状态选择输出格式。"""

# request.messages 是 request.state["messages"] 的快捷方式

message_count = len(request.messages)

if message_count < 3:

# 早期对话 - 使用简单格式

request = request.override(response_format=SimpleResponse)

else:

# 已建立对话 - 使用详细格式

request = request.override(response_format=DetailedResponse)

return handler(request)

agent = create_agent(

model="gpt-4.1",

tools=[...],

middleware=[state_based_output]

)

根据存储中的用户偏好配置输出格式:

from dataclasses import dataclass

from langchain.agents import create_agent

from langchain.agents.middleware import wrap_model_call, ModelRequest, ModelResponse

from pydantic import BaseModel, Field

from typing import Callable

from langgraph.store.memory import InMemoryStore

@dataclass

class Context:

user_id: str

class VerboseResponse(BaseModel):

"""包含详细信息的详细响应。"""

answer: str = Field(description="Detailed answer")

sources: list[str] = Field(description="Sources used")

class ConciseResponse(BaseModel):

"""简洁响应。"""

answer: str = Field(description="Brief answer")

@wrap_model_call

def store_based_output(

request: ModelRequest,

handler: Callable[[ModelRequest], ModelResponse]

) -> ModelResponse:

"""根据存储偏好选择输出格式。"""

user_id = request.runtime.context.user_id

# 从存储读取:获取用户的首选响应风格

store = request.runtime.store

user_prefs = store.get(("preferences",), user_id)

if user_prefs:

style = user_prefs.value.get("response_style", "concise")

if style == "verbose":

request = request.override(response_format=VerboseResponse)

else:

request = request.override(response_format=ConciseResponse)

return handler(request)

agent = create_agent(

model="gpt-4.1",

tools=[...],

middleware=[store_based_output],

context_schema=Context,

store=InMemoryStore()

)

根据运行时上下文(如用户角色或环境)配置输出格式:

from dataclasses import dataclass

from langchain.agents import create_agent

from langchain.agents.middleware import wrap_model_call, ModelRequest, ModelResponse

from pydantic import BaseModel, Field

from typing import Callable

@dataclass

class Context:

user_role: str

environment: str

class AdminResponse(BaseModel):

"""为管理员提供包含技术细节的响应。"""

answer: str = Field(description="Answer")

debug_info: dict = Field(description="Debug information")

system_status: str = Field(description="System status")

class UserResponse(BaseModel):

"""为普通用户提供的简单响应。"""

answer: str = Field(description="Answer")

@wrap_model_call

def context_based_output(

request: ModelRequest,

handler: Callable[[ModelRequest], ModelResponse]

) -> ModelResponse:

"""根据运行时上下文选择输出格式。"""

# 从运行时上下文读取:用户角色和环境

user_role = request.runtime.context.user_role

environment = request.runtime.context.environment

if user_role == "admin" and environment == "production":

# 生产环境中的管理员获得详细输出

request = request.override(response_format=AdminResponse)

else:

# 普通用户获得简单输出

request = request.override(response_format=UserResponse)

return handler(request)

agent = create_agent(

model="gpt-4.1",

tools=[...],

middleware=[context_based_output],

context_schema=Context

)

工具上下文

工具的特殊之处在于它们既读取又写入上下文。 在最基本的情况下,当工具执行时,它接收 LLM 的请求参数并返回工具消息。工具完成其工作并产生结果。 工具还可以为模型获取重要信息,使其能够执行和完成任务。读取

大多数现实世界的工具需要的不仅仅是 LLM 的参数。它们需要用户 ID 进行数据库查询、外部服务的 API 密钥,或当前会话状态来做出决策。工具从状态、存储和运行时上下文中读取以访问此信息。- 状态

- 存储

- 运行时上下文

从状态读取以检查当前会话信息:

from langchain.tools import tool, ToolRuntime

from langchain.agents import create_agent

@tool

def check_authentication(

runtime: ToolRuntime

) -> str:

"""检查用户是否已认证。"""

# 从状态读取:检查当前身份验证状态

current_state = runtime.state

is_authenticated = current_state.get("authenticated", False)

if is_authenticated:

return "User is authenticated"

else:

return "User is not authenticated"

agent = create_agent(

model="gpt-4.1",

tools=[check_authentication]

)

从存储读取以访问持久的用户偏好:

from dataclasses import dataclass

from langchain.tools import tool, ToolRuntime

from langchain.agents import create_agent

from langgraph.store.memory import InMemoryStore

@dataclass

class Context:

user_id: str

@tool

def get_preference(

preference_key: str,

runtime: ToolRuntime[Context]

) -> str:

"""从存储获取用户偏好。"""

user_id = runtime.context.user_id

# 从存储读取:获取现有偏好

store = runtime.store

existing_prefs = store.get(("preferences",), user_id)

if existing_prefs:

value = existing_prefs.value.get(preference_key)

return f"{preference_key}: {value}" if value else f"No preference set for {preference_key}"

else:

return "No preferences found"

agent = create_agent(

model="gpt-4.1",

tools=[get_preference],

context_schema=Context,

store=InMemoryStore()

)

从运行时上下文读取配置,如 API 密钥和用户 ID:

from dataclasses import dataclass

from langchain.tools import tool, ToolRuntime

from langchain.agents import create_agent

@dataclass

class Context:

user_id: str

api_key: str

db_connection: str

@tool

def fetch_user_data(

query: str,

runtime: ToolRuntime[Context]

) -> str:

"""使用运行时上下文配置获取数据。"""

# 从运行时上下文读取:获取 API 密钥和数据库连接

user_id = runtime.context.user_id

api_key = runtime.context.api_key

db_connection = runtime.context.db_connection

# 使用配置获取数据

results = perform_database_query(db_connection, query, api_key)

return f"Found {len(results)} results for user {user_id}"

agent = create_agent(

model="gpt-4.1",

tools=[fetch_user_data],

context_schema=Context

)

# 使用运行时上下文调用

result = agent.invoke(

{"messages": [{"role": "user", "content": "Get my data"}]},

context=Context(

user_id="user_123",

api_key="sk-...",

db_connection="postgresql://..."

)

)

写入

工具结果可用于帮助代理完成给定任务。工具既可以将结果直接返回给模型,也可以更新代理的内存,使重要上下文可用于后续步骤。- 状态

- 存储

使用 Command 写入状态以跟踪会话特定信息:

from langchain.tools import tool, ToolRuntime

from langchain.agents import create_agent

from langgraph.types import Command

@tool

def authenticate_user(

password: str,

runtime: ToolRuntime

) -> Command:

"""认证用户并更新状态。"""

# 执行认证(简化版)

if password == "correct":

# 写入状态:使用 Command 标记为已认证

return Command(

update={"authenticated": True},

)

else:

return Command(update={"authenticated": False})

agent = create_agent(

model="gpt-4.1",

tools=[authenticate_user]

)

写入存储以跨会话持久化数据:

from dataclasses import dataclass

from langchain.tools import tool, ToolRuntime

from langchain.agents import create_agent

from langgraph.store.memory import InMemoryStore

@dataclass

class Context:

user_id: str

@tool

def save_preference(

preference_key: str,

preference_value: str,

runtime: ToolRuntime[Context]

) -> str:

"""将用户偏好保存到存储。"""

user_id = runtime.context.user_id

# 读取现有偏好

store = runtime.store

existing_prefs = store.get(("preferences",), user_id)

# 与新偏好合并

prefs = existing_prefs.value if existing_prefs else {}

prefs[preference_key] = preference_value

# 写入存储:保存更新后的偏好

store.put(("preferences",), user_id, prefs)

return f"Saved preference: {preference_key} = {preference_value}"

agent = create_agent(

model="gpt-4.1",

tools=[save_preference],

context_schema=Context,

store=InMemoryStore()

)

生命周期上下文

控制核心代理步骤之间发生的事情——拦截数据流以实现横切关注点,如摘要、防护栏和日志记录。 正如您在模型上下文和工具上下文中看到的,中间件 是使上下文工程变得实用的机制。中间件允许您挂钩到代理生命周期的任何步骤,并:- 更新上下文 - 修改状态和存储以持久化更改、更新对话历史或保存见解

- 在生命周期中跳转 - 根据上下文移动到代理周期中的不同步骤(例如,如果满足条件则跳过工具执行,使用修改后的上下文重复模型调用)

示例:摘要

最常见的生命周期模式之一是在对话历史过长时自动压缩它。与模型上下文中显示的临时消息修剪不同,摘要持久更新状态——用保存供所有未来轮次使用的摘要永久替换旧消息。 LangChain 为此提供了内置中间件:from langchain.agents import create_agent

from langchain.agents.middleware import SummarizationMiddleware

agent = create_agent(

model="gpt-4.1",

tools=[...],

middleware=[

SummarizationMiddleware(

model="gpt-4.1-mini",

trigger={"tokens": 4000},

keep={"messages": 20},

),

],

)

SummarizationMiddleware 会自动:

- 使用单独的 LLM 调用总结较旧的消息

- 在状态中用摘要消息永久替换它们

- 保留最近的消息以保持上下文

有关内置中间件、可用钩子以及如何创建自定义中间件的完整列表,请参阅中间件文档。

最佳实践

- 从简单开始 - 从静态提示和工具开始,仅在需要时添加动态功能

- 逐步测试 - 一次添加一个上下文工程功能

- 监控性能 - 跟踪模型调用、令牌使用情况和延迟

- 使用内置中间件 - 利用

SummarizationMiddleware、LLMToolSelectorMiddleware等。 - 记录您的上下文策略 - 明确说明传递了哪些上下文以及原因

- 理解临时与持久:模型上下文更改是临时的(每次调用),而生命周期上下文更改会持久保存到状态

相关资源

连接这些文档 到 Claude、VSCode 等,通过 MCP 获取实时答案。