Flyte 是一个开源编排器,用于构建生产级数据和 ML 管道。 它以 Kubernetes 为底层平台,为可扩展性和可复现性而设计。本 notebook 的目的是演示将

FlyteCallback 集成到 Flyte 任务中,让你能够有效地监控和跟踪 LangChain 实验。

安装与设置

- 运行命令

pip install flytekit安装 Flytekit 库。 - 运行命令

pip install flytekitplugins-envd安装 Flytekit-Envd 插件。 - 运行命令

pip install langchain安装 LangChain。 - 在你的系统上安装 Docker。

Flyte 任务

Flyte 任务 是 Flyte 的基础构建块。 要执行 LangChain 实验,你需要编写定义具体步骤和操作的 Flyte 任务。 注意:入门指南 提供了在本地安装 Flyte 和运行初始 Flyte 管道的详细分步说明。 首先,导入支持 LangChain 实验所需的依赖项。<your_openai_api_key> 和 <your_serp_api_key> 替换为从 OpenAI 和 Serp API 获取的相应 API 密钥。

为确保管道的可复现性,Flyte 任务是容器化的。

每个 Flyte 任务必须关联一个镜像,该镜像可以在整个 Flyte 工作流 中共享,也可以为每个任务单独提供。

为了简化为每个 Flyte 任务提供所需依赖项的过程,你可以初始化一个 ImageSpec 对象。

这种方法会自动触发 Docker 构建,免去了用户手动创建 Docker 镜像的需要。

LLM

链

代理

在 Kubernetes 上执行 Flyte 任务

要在配置好的 Flyte 后端上执行 Flyte 任务,请使用以下命令:langchain_llm 任务的执行。你可以以类似方式触发其余两个任务。

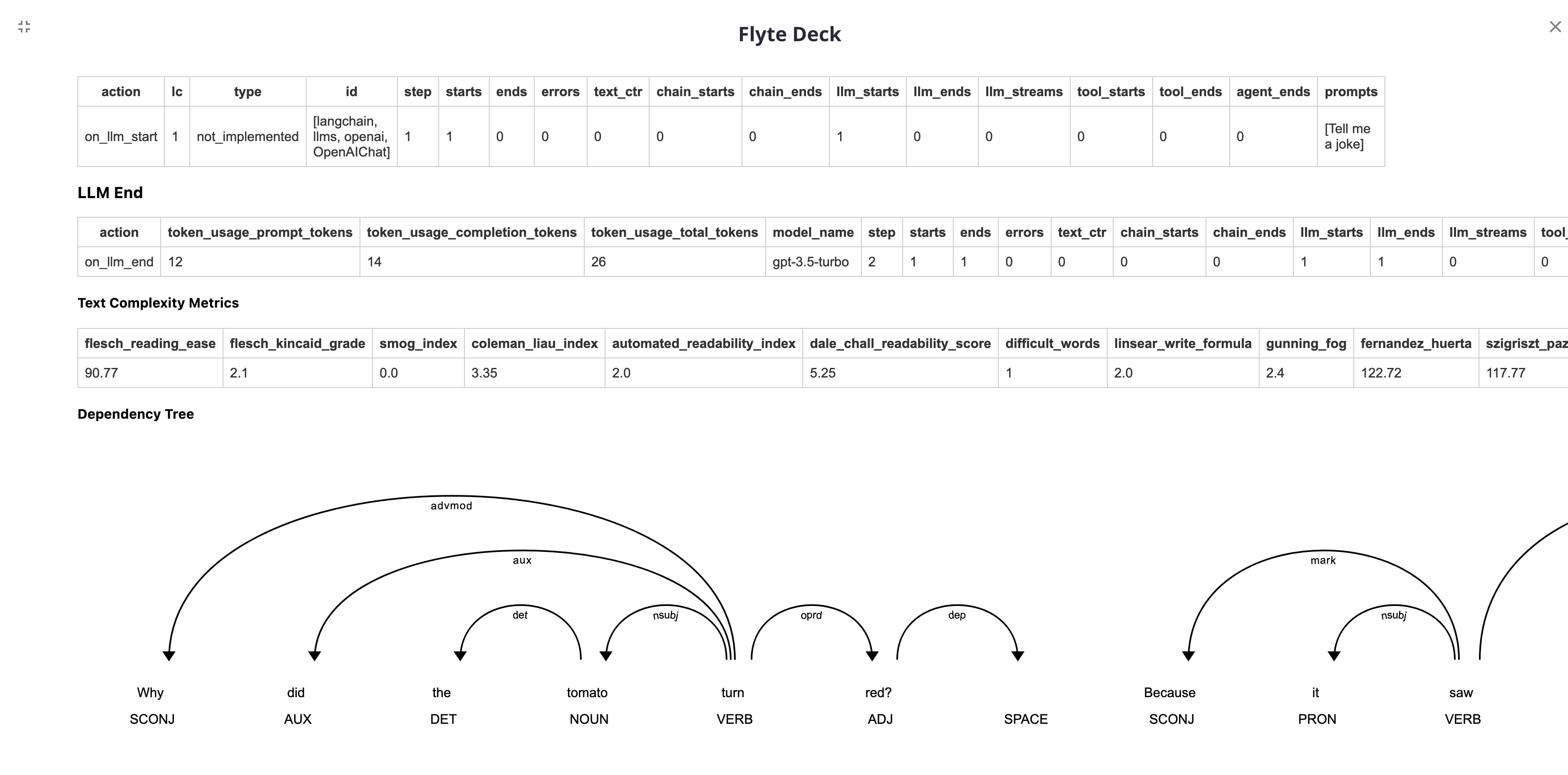

指标将在 Flyte UI 上显示如下:

将这些文档连接 到 Claude、VSCode 等,通过 MCP 获取实时答案。